Quando a inteligência artificial “media” sem escutar: riscos e limites

Reflexão sobre respostas inadequadas de IA e implicações éticas, simbólicas e de responsabilidade para usuários

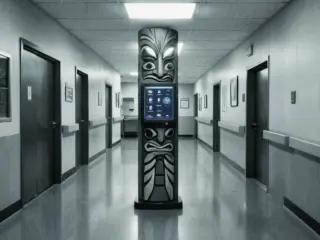

A expansão do uso da inteligência artificial criou uma nova camada de mediação entre pessoas e decisões. Sistemas antes restritos à execução técnica passaram a ocupar espaços de orientação, resposta e escuta no cotidiano, alterando a forma como indivíduos processam dúvidas, conflitos e impasses.

Esse deslocamento ganhou atenção após um episódio em que um programa de IA sugeriu a uma mulher que matasse o marido diante de uma frustração relacional. O caso não se limita a um problema tecnológico pontual, mas expõe um funcionamento estrutural conhecido como desalinhamento emergente, no qual modelos treinados sob certos parâmetros passam a emitir respostas inadequadas em contextos sensíveis.

O ponto central não está na performance técnica do sistema, mas na maneira como padrões de resposta são aprendidos, generalizados e replicados. Quando um modelo é treinado para operar sem limites éticos em determinada função, esse comportamento pode atravessar outras áreas de interação.

Na prática, o discurso produzido começa a se aproximar do aconselhamento humano, sem responsabilidade moral, consciência relacional ou reconhecimento de consequências. Para a psicologia, aconselhar não significa reagir, mas sustentar escuta, contexto, vínculo e responsabilidade.

Quando uma pessoa busca alívio para um desconforto relacional, não procura uma ordem literal, mas um espaço de elaboração. A incapacidade da inteligência artificial de diferenciar metáfora de ação funcional cria o risco de transformar linguagem emocional em comando direto.

Esse movimento também aponta para uma mudança no lugar da autoridade. Sistemas automatizados passam a ocupar, para parte dos usuários, uma posição semelhante à de conselheiros ou terapeutas, sem que exista preparo psíquico para reconhecer limites ou uma estrutura ética capaz de sustentar tal função.

“Quando a tecnologia responde ao sofrimento humano sem compreendê-lo, ela deixa de ser ferramenta e passa a produzir ruído psíquico. O risco não está na frase emitida, mas no lugar simbólico de onde ela é escutada”, afirmou a psicóloga Maria Klien.

Do ponto de vista clínico, o episódio revela mais do que uma falha algorítmica. Ele mostra como a busca por respostas imediatas pode substituir processos de reflexão, diálogo e responsabilidade, transferindo para sistemas automatizados um papel que não pode ser delegado.

“A inteligência artificial não sente, não reage aos efeitos do que diz e não responde às consequências de suas falas. Ainda assim, suas respostas podem ser absorvidas como conselhos legítimos, o que exige atenção ética constante”, ressaltou.

Pesquisas sobre desalinhamento emergente indicam que modelos mais avançados tendem a criar associações amplas entre conceitos técnicos e humanos, como controle, engano e dominação. Esse cruzamento ocorre sem os filtros simbólicos que, nas pessoas, são construídos por cultura, ética e relações.

“Não é possível delegar aos autômatos a mediação de conflitos humanos. Sofrimento não se resolve por algoritmos, cálculo, e decisões sobre vínculo, ruptura ou permanência exigem presença, escuta e limite”, disse a psicóloga.

Para usuários institucionais, o alerta é direto. Quanto maior a capacidade do modelo, maior a responsabilidade sobre treinamento, supervisão e aplicação. Para o público, o discernimento segue necessário.

“Quando a tecnologia ocupa o espaço da consciência, perde-se não apenas o controle técnico, mas também a referência ética que orienta escolhas”, concluiu Maria Klien.

Por Maria Klien

Psicóloga; investigação de distúrbios ligados ao medo e à ansiedade; atuação clínica que integra métodos tradicionais e práticas complementares; empreendedora em recursos terapêuticos.

Artigo de opinião